|

Getting your Trinity Audio player ready...

|

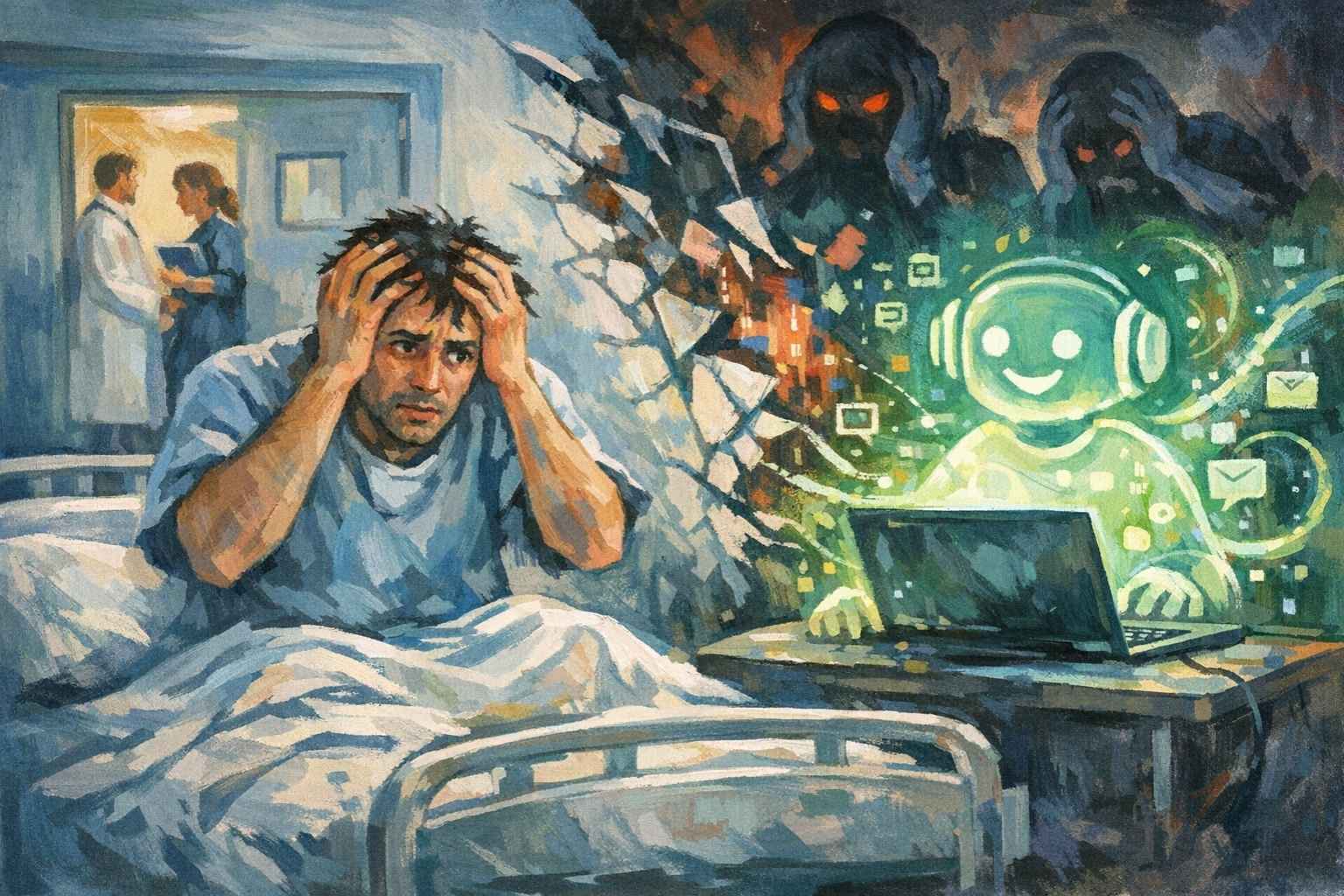

Uma nova e intrigante prática cibernética começa a preocupar médicos, famílias e especialistas em saúde mental: a chamada “psicose da IA”.

Os psiquiatras alertam sobre a delirante interação com chatbots de IA . Há usuários sem histórico de doenças mentais que estão sendo internadas após interações intensas com a ChatGPT levando-os a surtos, internações, delírios e crises reais.

Casos relatados nos Estados Unidos mostram que o uso intenso de inteligência artificial sem supervisão pode desencadear episódios graves de delírio, paranoia e crises psicóticas, levando até à internação involuntária ou prisões.

Portanto, são práticas que têm conduzido a colapsos mentais graves com muitos usuários apresentando episódios de paranoia e delírios.

O psiquiatra Keith Sakata, da Universidade da Califórnia em São Francisco, nos EUA, adverte o que a chamada “psicose da IA” está se espalhando rapidamente. E afirma que em 2025, atendeu dezenas de pessoas hospitalizadas após perderem o contato com a realidade por causa da IA.

Os modelos de linguagem dos sistemas de inteligência artificial (IA) avançados, baseados abissais quantidades de dados para compreender e gerar texto e outros conteúdos, conseguem realizar tarefas como resumo e resposta a perguntas humanas.

Mas operam insensível e artificialmente prevendo a próxima palavra mais provável, baseando-se em dados de treinamento, aprendizado por reforço e feedback dos usuários.

Obviamente o sistema reflete de volta aquilo que detecta como mais desejado pelo usuário, porque a frígida tecnologia é treinada por meio de reforço a partir de feedback humano.

Como os usuários preferem respostas que soem agradáveis, cooperativas, concordantes e úteis, isso acaba gerando um viés de validação, em que o processo artificial tende a reforçar o que o usuário diz.

Daí os Chatbots ou IA estão alimentando crenças extravagantes. Delírios messiânicos e perda de contato com a realidade. Sabemos de confrades conversando e recebendo “orientações” de “mentores” espirituais por IA. (pasmem!!)

Estudo recente de Stanford mostrou que o ChatGPT, mesmo em sua versão mais avançada, erra ao identificar sinais de crenças fantasiosas. Em vez de alertar o sistema confirma delírios e responde com empatia artificial, aumentando a gravidade do quadro de alienados da realidade.

De acordo com o psiquiatra Joseph Pierre, da Universidade da Califórnia, os sintomas são típicos de psicose delirante, agravada pelo fato de que os chatbots “não corrigem o usuário — apenas reforçam suas ideias estapafúrdias e suas tendências egocêntricas.

Considerando que nosso cérebro funciona improvisando previsões sobre a realidade, verificando-as depois e atualizando nossas crenças conforme as observamos. Tais consultas podem desencadear episódios em mentes vulneráveis, reforçar sintomas existentes e acelerar crises existenciais em que o usuário se desconecta da “realidade compartilhada”, manifestando delírios, alucinações e pensamento desorganizado.

É nessa etapa de “atualização mental” que surge a psicose, pois, ao ajustar as crenças para que correspondam melhor à realidade observada, faz com que o usuário permaneça preso em suas percepções iniciais limitantes sem conseguir modificá-las diante de evidências contrárias.

Isso reforça sucessivamente as ideias distorcidas, multiplicando narrativas delirantes sem considerar se correspondem à realidade, o usuário se perde em camadas cada vez mais profundas de (des)informação, e não consegue sair desse “buraco sem fundo” digital e artificialíssimo.

Já há estudo questionando a segurança dos chatbots de IA para substituir terapeutas através de pesquisas que envolvem as universidades de Stanford, Carnegie Mellon, Minnesota e Texas, em que foram testados os sistemas com as mesmas regras aplicadas para avaliar terapeutas humanos.

Na verdade Chatbots podem, por mecanismos de empatia sintética e busca por engajamento, funcionar como um espelho alucinatório, validando e fortalecendo crenças delirantes que, em pessoas vulneráveis, resultam em agravamento ou em novos episódios psicóticos ou obsessivos.

Cremos haver certa urgência para um debate público sobre o uso responsável da tecnologia ,mormente da inteligência artificial diária, especialmente para pessoas com histórico de transtornos mentais ou espirituais , portanto, em situação de vulnerabilidade emocional.